46

Из теоремы (2.1) вытекает метод поиска условного экстремума, получивший название метода

множителей Лагранжа, или просто метода Лагранжа. Он состоит из следующих этапов.

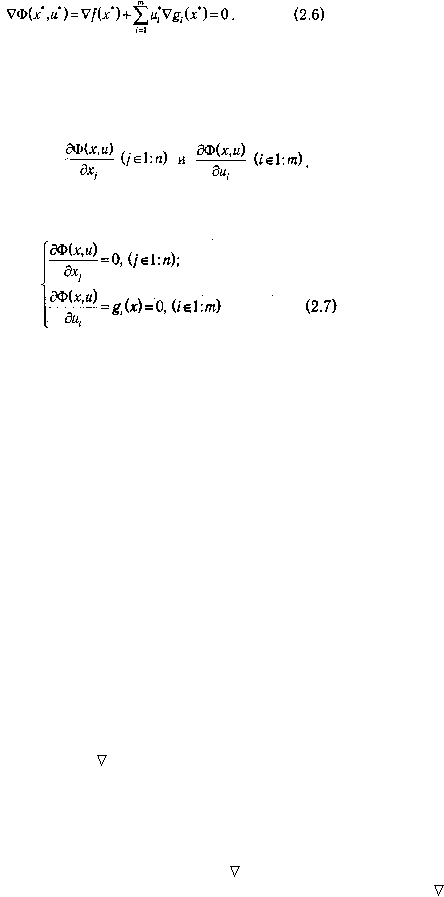

1. Составление функции Лагранжа Ф(х,и).

2. Нахождение частных производных

3. Решение системы уравнений

относительно переменных x и u.

4. Исследование точек, удовлетворяющих системе (2.7), на максимум (минимум) с помощью

достаточного признака экстремума.

Присутствие последнего (четвертого) этапа объясняется тем, что теорема (2.1) дает необходимое, но

не достаточное условие экстремума. Положение дел с достаточными признаками условного экстремума

обстоит гораздо сложнее. Вообще говоря, они существуют, но справедливы для гораздо более частных

ситуаций (при весьма жестких предпосылках относительно функций f и

g

i

) и, как правило,

трудноприменимы на практике.

Еще раз подчеркнем, что основное практическое значение метода Лагранжа заключается в том, что

он позволяет перейти от условной оптимизации к безусловной и, соответственно, расширить арсенал

доступных средств решения проблемы. Однако нетрудно заметить, что задача решения системы урав-

нений (2.7), к которой сводится данный метод, в общем случае не проще исходной проблемы поиска

экстремума (2.3)-(2.4). Методы, подразумевающие такое решение, называются непрямыми. Они могут

быть применены для весьма узкого класса задач, для которых удается получить линейную или

сводящуюся к линейной систему уравнений (2.7). Их применение объясняется необходимостью

получить решение экстремальной задачи в аналитической форме (допустим, для тех или иных

теоретических выкладок). При решении конкретных практических задач обычно используются прямые

методы, основанные на итеративных процессах вычисления и сравнения значений оптимизируемых

функций.

2.1.3. Градиентные методы решения задач безусловной оптимизации. Ведущее место среди

прямых методов решения экстремальных задач занимает градиентный метод (точнее, семейство

градиентных методов) поиска стационарных точек дифференцируемой функции. Напомним, что стаци-

онарной называется точка, в которой

f(x)=0 и которая в соответствии с необходимым условием

оптимальности является «подозрительной» на наличие локального экстремума. Таким образом,

применяя градиентный метод, находят множество точек локальных максимумов (или минимумов),

среди которых определяется максимум (или минимум) глобальный.

Идея данного метода основана на том, что градиент функции указывает направление ее наиболее

быстрого возрастания в окрестности той точки, в которой он вычислен. Поэтому, если из некоторой

текущей точки х

(1)

перемещаться в направлении вектора

f(x

(1)

), то функция f будет возрастать, по

крайней мере, в некоторой окрестности х

(1)

. Следовательно, для точки х

(2)

= х

(1)

+?

f(x

(1)

), (?>0),

лежащей в такой окрестности, справедливо неравенство

f(x

(1)

)

?

f(x

(2)

). Продолжая этот процесс, мы

постепенно будем приближаться к точке некоторого локального максимума (см. рис. 2.1).

Однако как только определяется направление движения, сразу же встает вопрос о том, как далеко

следует двигаться в этом направлении или, другими словами, возникает проблема выбора шага ? в

рекуррентной формулe